|

||

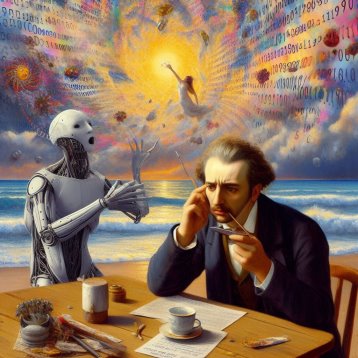

Requête: Pouvez-vous dessiner une IA perplexe devant le texte qu'elle vient de créer et qui ressemble à une hallucination. |

"Hallucination" conclusion provisoire Note 26 janvier 2025: J'étais bien persuadée que les fausses réponses des IA iraient décroissant en raison des suites de l'apprentissage et du nombre incalculable des inter-relations correctrices. Mais un autre système, en place sur ChatGPT4 , nommé pipeline d'inférence, permet à ce système de trier et lisser les réponses "en coulisse" avant de les donner.Les êtres comme le neurone à manganèse et autres nouvelles chimères n'ont plus beaucoup de chance d'échapper à ce tri. Je laisse en ligne pour le moment toute cette discussion autour de l'usage du mot "hallucination": c'est un bon témoin de nos errements dans nos premiers usages des IA. Je laisse en ligne pour le moment cette discussion déjà périmée, comme témoin de nos errements. ............................................................. Le lien vers une émission de Radio Canada du 22 novembre 2023(1) que donne Copilot permet de saisir le moment où ce terme -qui circulait depuis 2018- a été "officialisé" dans le contexte des IA. "Quelques semaines après que le dictionnaire britannique Collins a désigné « AI » (intelligence artificielle ou IA, en français) comme son « mot de l’année 2023 », un autre dictionnaire, le Cambridge, persiste et signe sur le thème de l’IA en couronnant « hallucinate » (halluciner ou, par extension, hallucination) à ce titre. Précédemment, j'avais constaté que les listes de vocabulaire propres aux IA, proposées en français, celle de la CNIL Glossaire de l'intelligence artificielle , celle du gouvernement français Vocabulaire de l'intelligence artificielle (liste de termes, expressions et définitions adoptés) ne contenaient pas ce mot "hallucination". Voilà ce que dit en 2023 le Dictionnaire de Cambridge,lorsqu'il l'introduit à la suite de sa définition psychiatrique: When an artificial intelligence (= a computer system that has some of the qualities that the human brain has, such as the ability to produce language in a way that seems human) hallucinates, it produces false information: Hallucination noun (COMPUTERS) | |

|

Henry Shevlin, éthicien de l’IA à l’Université de Cambridge, a été surpris de constater qu’au lieu de choisir un mot comme bogue, les gens ont préféré utiliser ce qu’il décrit être un verbe psychologique vif pour décrire les divagations des réponses de l’IA générative. Il explique ce choix par la tendance qu’ont les êtres humains à anthropomorphiser ces systèmes, de les traiter comme s’ils avaient un esprit propre, décrit-il dans un billet de blogue sur le site du dictionnaire Cambridge.(article cité). | ||